Windows Copilot+ PCの最前線で活躍する、マイクロソフトの新しい小規模言語モデル「Mu」について、その魅力と可能性を深掘りしていきましょう。

先日発表されたマイクロソフトの新しい言語モデル「Mu」は、可能性を大いに感じさせるものでした。

Mu言語モデルとは? Copilot+ PCで何が変わる?

マイクロソフトが発表した「Mu」は、最新のオンデバイス小規模言語モデルです。Copilot+ PCという、AI処理に特化した新しいカテゴリのPCに搭載されることを前提に設計されています。具体的には、このモデルがWindowsの設定エージェントの基盤となっており、私たちが自然言語で質問や指示をすることで、PCの設定をスムーズに変更できるようになるんです。

想像してみてください。これまでは設定画面をあちこち探したり、複雑な手順を踏んだりしていた作業が、「画面の明るさを上げて」「通知をオフにして」といった言葉で瞬時にできるようになるわけです。これはまさに、AIが私たちの単純作業を肩代わりし、本質的なクリエイティブ活動に時間を集中させてくれる、理想的な姿ではないでしょうか。

マイクロソフトとはどんな企業?

ここで少し、Muを開発したマイクロソフトについて触れておきましょう。言わずと知れたソフトウェア業界の巨人ですね。Windows OS、Office製品(Word, Excel, PowerPointなど)、Xbox、Surfaceといったハードウェアから、クラウドサービスのAzureまで、幅広い事業を展開しています。

特に最近では、OpenAIへの巨額投資を通じて、ChatGPTなどの生成AI技術をMicrosoft製品に統合する動きを加速させています。今回のMuも、そうしたAI戦略の一環であり、デバイス上でのAI処理(エッジAI)の重要性を強く意識していることがうかがえます。彼らが目指すのは、AIが私たちの日常に溶け込み、より自然で直感的なコンピューティング体験を提供することにあると言えるでしょう。

注目ポイント📌

🚀 Copilot+ PCでのAI体験を支える基盤技術

🗣️ 自然言語でPC設定を操作できる未来

💻 世界最大のソフトウェア企業マイクロソフトのAI戦略

Muモデルの裏側:小さな巨人の秘密

Muが驚くべきはその効率性です。わずか3億3千万のパラメーターを持つ小規模モデルでありながら、非常に高いパフォーマンスを発揮します。この秘密は、そのアーキテクチャと最適化に隠されています。

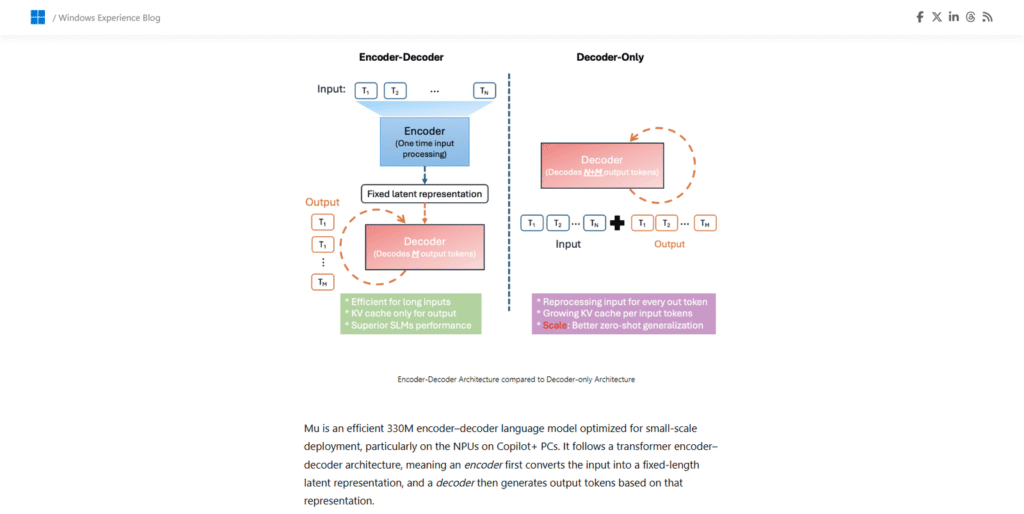

エンコーダー・デコーダー構造の魔法

Muは「エンコーダー・デコーダー」と呼ばれる構造を採用しています。これは、入力された情報を一度コンパクトな「潜在表現」に変換し、それをもとに必要な出力を生成するというものです。この構造は、入力と出力を分離して処理できるため、一般的な「デコーダーのみ」のモデルに比べて、計算量とメモリ消費を大幅に削減できるというメリットがあります。

具体的には、Qualcomm Hexagon NPU(モバイルAIアクセラレーター)でのテストでは、最初のトークン出力までのレイテンシが約47%も低減され、デコード速度はなんと4.7倍も向上したそうです。この高速性は、設定エージェントのようにリアルタイム性が求められるアプリケーションには不可欠ですよね。クリエイターが待つことなく、サクサクと作業を進められるのは、ストレスフリーで創造性を高める上で非常に重要です。

NPU最適化と量子化技術

Muは、NPU(Neural Processing Unit)という、AIの計算に特化したプロセッサで効率的に動作するように設計されています。NPUの並列処理能力やメモリ制限に合わせて、モデルの構造やパラメーターが細かく調整されています。

さらに、「量子化」という技術が使われています。これは、モデルの重みや計算を、より少ない情報量(例えば、浮動小数点から整数)で表現することで、メモリ使用量を減らし、計算速度を上げる技術です。これにより、モデルの精度を保ちつつ、Copilot+ PCのようなエッジデバイスでもスムーズに動作させることが可能になっています。

注目ポイント📌

💡 エンコーダー・デコーダーで高速&低負荷を実現

💨 NPU特化設計と量子化でエッジデバイスでも爆速

⚙️ 裏側で働くAI技術がクリエイティブを加速

小さくてもパワフル!Muの技術的飛躍

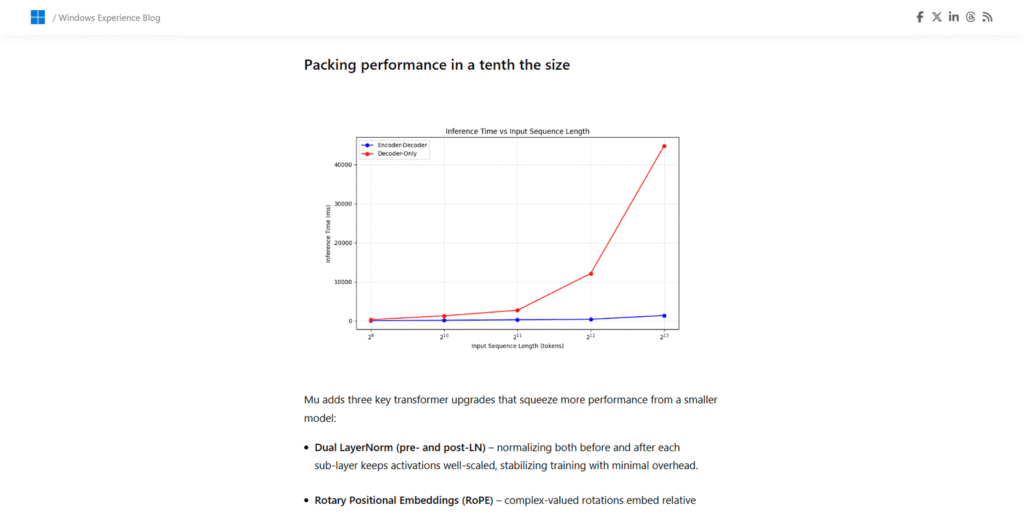

Muは、サイズが小さいながらも高性能を実現するために、最先端の技術が盛り込まれています。

- Dual LayerNorm: モデルの安定性を高め、トレーニングを効率化します。

- Rotary Positional Embeddings (RoPE): 長い文章の理解を深め、トレーニングデータにない長さの文章にも対応できるようにします。

- Grouped-Query Attention (GQA): メモリと電力を節約しつつ、注意メカニズムの多様性を保ちます。

これらの技術革新により、Muは限られたリソースのエッジデバイスでも、高い精度と高速な推論を実現しています。

他のモデルとの比較でわかる実力

驚くべきことに、MuはPhi-3.5-miniという別の高性能モデルと比較して、サイズが10分の1であるにもかかわらず、ほぼ同等のパフォーマンスを発揮するという結果が出ています。

これは、限られたデバイスリソースの中で、いかに効率よくAIを動作させるかという点で、大きなブレークスルーと言えるでしょう。クリエイターにとって、高性能なAIがローカル環境で軽快に動作することは、アイデアを形にするまでのタイムラグを減らし、より試行錯誤に時間を費やせるようになることを意味します。

注目ポイント📌

💪 サイズの常識を覆す技術的進化

📊 Phi-3.5-miniに匹敵するパフォーマンス

⏱️ クリエイティブ作業の試行錯誤を加速

設定エージェントへの応用と今後の展望

Muは、Windowsの設定エージェントという具体的な用途に合わせて、さらに微調整(ファインチューニング)されています。最初は精度に課題があったものの、360万もの大量のサンプルデータで学習させ、多岐にわたる設定項目に対応できるように進化しました。

これにより、わずか500ミリ秒未満という驚異的な応答速度で、ユーザーの自然言語クエリに応じて設定を調整できるようになったのです。ユーザーが曖昧な言葉を使っても、AIが意図を正確に読み取り、適切な設定変更を提案できるよう、工夫が凝らされています。

AIと人間の共存、そしてクリエイターの役割

今回のMuの登場は、AIが単なるツールとしてだけでなく、私たちの作業プロセスに深く入り込み、クリエイターが「本当に集中したいこと」に時間を割けるようにするパートナーとしての可能性を改めて示してくれました。

AIが単純な作業や情報の検索、設定の調整などを効率化してくれることで、私たちは、人間ならではの感性、発想力、そして「なぜこれを作るのか」という本質的な問いに、より多くの時間とエネルギーを注ぐことができるようになります。

AIはまだ完璧ではありません。特に、意図の解釈や複雑な判断、そして何よりも「創造性」そのものにおいては、人間の役割が不可欠です。AIが進化すればするほど、私たちクリエイターは、AIが代替できない領域で、いかに自身の価値を発揮できるかを真剣に考える必要があります。Muのような技術は、そのための時間と余力を私たちに与えてくれる、貴重な存在となるでしょう。

注目ポイント📌

💬 設定エージェントでの実践的な活用

🤝 AIがクリエイターの「パートナー」となる未来

🎨 AI時代に問われる人間の「創造性」の価値

関連情報と参考資料

コメント